Disney Research: Neue, Effiziente Methode zur Rekonstruktion von Gigaray Lichtfeldern

Aktuelle Algorithmen für die Auswertung von Lichtfeld-Bildern sind vor allem dafür ausgelegt, mit relativ niedrigen Bildauflösungen im Bereich einiger Megapixel möglichst schnell Ergebnisse zu zeigen. Durch diesen Umstand könnte Lichtfeld-Technologie auch bei steigenden Sensorauflösungen weiterhin in ihrer Auflösung beschränkt bleiben. Die Analyse von Lichtfeldern mit hoher räumlicher Auflösung, sogenannter Gigaray Lichtfelder, bleibt durch die benötigten Rechen-Ressourcen auch weiterhin eine technische Herausforderung.

Wissenschafter von Disney Research in Zürich stellten vor kurzem einen neuen, schnelleren Weg zur Auswertung solcher Lichtfelder vor. Ihr Geheimnis: Einige etablierte Vorgehensweisen ignorieren und etwas neues versuchen.

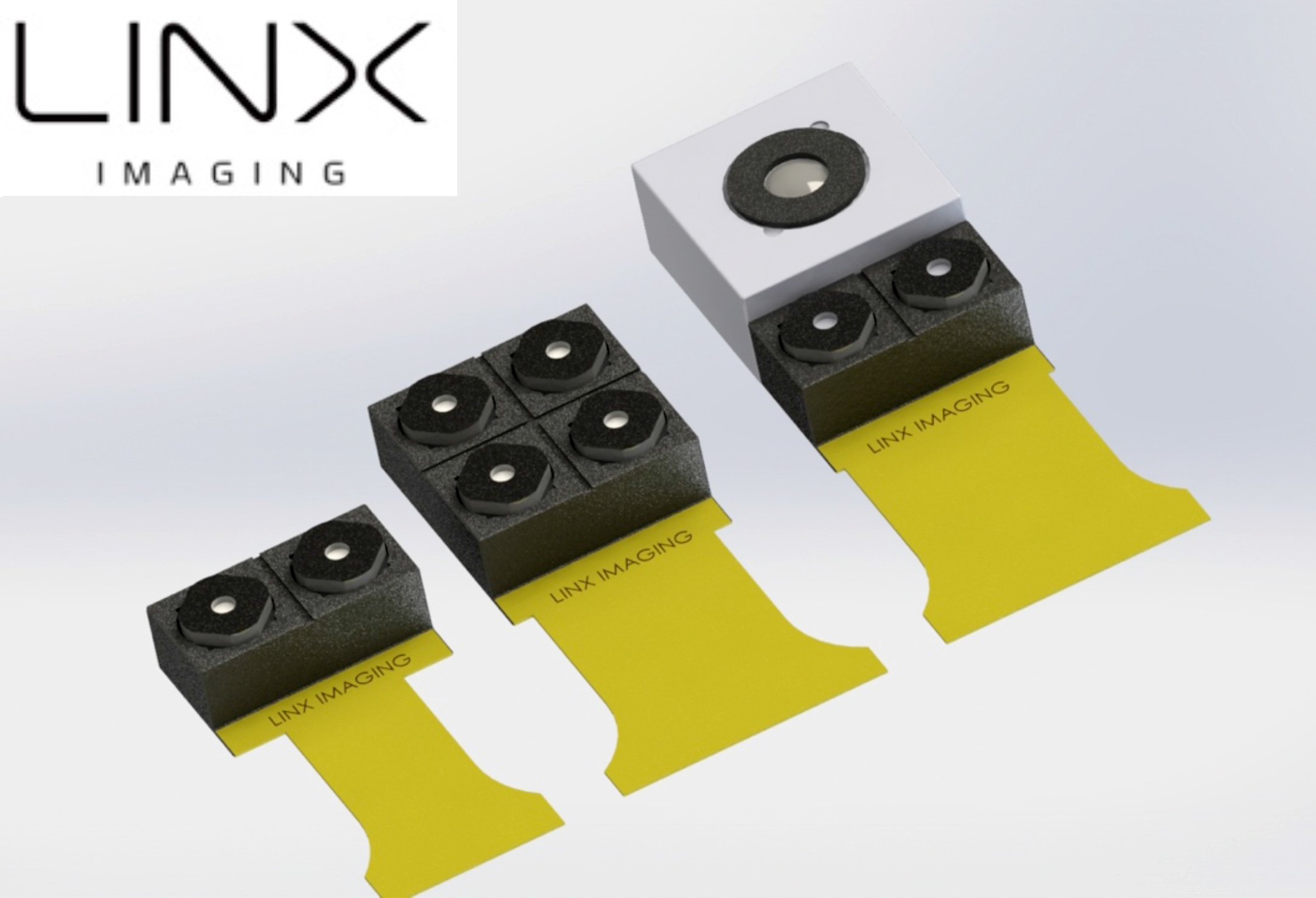

Mit beachtlichen Datensätzen aus 100 einzelnen Spiegelreflex-Fotos (je 21 Megapixel) entwickelten Changil Kim und Kollegen einen Algorithmus, mit dem Gigaray Lichtfelder auf einer herkömmlichen, aktuellen GPU (Grafik-Prozessoreinheit) berechnet werden können. Die genaue Auswertung geschieht dabei auf der Ebene einzelner Pixel, und nicht Bildbereiche, und konzentriert sich auf Objektränder. Die gleichmäßige Rekonstruktion von Innenbereichen dieser Objekte geschieht anschließend in einem zweiten Rechenschritt.

Wie gezeigt wird, eignet sich der Algorithmus sowohl für lineare Lichtfelder (aufgezeichnet mit Spiegelreflex-Kamera und Kamerawagen) und Bilddaten, die mit einer in der Hand gehaltenen Kamera aufgenommen wurden.

Die 3D Rekonstruktion verläuft im vergleich zu bestehenden Methoden viel schneller, und besticht vor allem durch hohe Detailgenauigkeit und äußerst präzise Objektabgrenzung.

Warum interessiert sich Disney für Lichtfeld-Technologie? Hochauflösende 3D Computermodelle von komplexen Szenen in der realen Welt sind inzwischen zu einem der wichtigsten Aspekte heutiger Filmproduktionen geworden. Laut Co-Author Alexander Sorkine-Hornung ist 3D Modelling aber nur der Anfang:

Three-dimensional models have become increasingly important for digitizing, visualizing and archiving the real world. In movie production, for instance, creating accurate 3D models of movie sets is often necessary for post-production tasks such as integrating real-world imagery with computer-generated effects.

“Our method could be used for applications such as automatic image segmentation, which would simplify background removal in detailed scenes. It also would be useful for image-based rendering, in which new 2D images are created by combining real images.”

Abstract der Publikation:

This paper describes a method for scene reconstruction of complex, detailed environments from 3D light fields. Densely sampled light fields in the order of 10^9 light rays allow us to capture the real world in unparalleled detail, but efficiently processing this amount of data to generate an equally detailed reconstruction represents a significant challenge to existing algorithms.

We propose an algorithm that leverages coherence in massive light fields by breaking with a number of established practices in image-based reconstruction. Our algorithm first computes reliable depth estimates specifically around object boundaries instead of interior regions, by operating on individual light rays instead of image patches. More homogeneous interior regions are then processed in a fine-to-coarse procedure rather than the standard coarse-to-fine approaches. At no point in our method is any form of global optimization performed. This allows our algorithm to retain precise object contours while still ensuring smooth reconstructions in less detailed areas. While the core reconstruction method handles general unstructured input, we also introduce a sparse representation and a propagation scheme for reliable depth estimates which make our algorithm particularly effective for 3D input, enabling fast and memory efficient processing of “Gigaray light fields” on a standard GPU.

We show dense 3D reconstructions of highly detailed scenes, enabling applications such as automatic segmentation and image-based rendering, and provide an extensive evaluation and comparison to existing image-based reconstruction techniques.

Nähere Informationen: Kim C, Zimmer H, Pritch Y, Sorkine-Hornung A, Gross M (2013) Scene Reconstruction from High Spatio-Angular Resolution Light Fields. ACM Transactions on Graphics 32(4) (Proceedings of SIGGRAPH 2013)

Neueste Kommentare