Nvidia Near-Eye Lichtfeld Display: Hintergrund und Entwicklung [Video]

Vor circa einem Jahr stellte Nvidia eine neuartige Virtual Reality Brille, die auf Lichtfeld-Technologie basiert und dadurch dem menschlichen Auge sowohl räumliche Tiefe als auch Refokus-Eindruck bietet. Das sogenannte Near-Eye Lichtfeld Display war eher eine Machbarkeitsstudie, stellt allerdings eine aufregende neue Technologie dar, die eine Reihe von Problemen mit anderen Virtual Reality Headsets lösen kann.

Vor circa einem Jahr stellte Nvidia eine neuartige Virtual Reality Brille, die auf Lichtfeld-Technologie basiert und dadurch dem menschlichen Auge sowohl räumliche Tiefe als auch Refokus-Eindruck bietet. Das sogenannte Near-Eye Lichtfeld Display war eher eine Machbarkeitsstudie, stellt allerdings eine aufregende neue Technologie dar, die eine Reihe von Problemen mit anderen Virtual Reality Headsets lösen kann.

Nvidia-Forscher Douglas Lanman stellte vor kurzem in einer Präsentation auf der Augmented World Expo (AWE2014) die Hintergründe und Geschichte von sogenannten Head-Mounted-Displays vor, und zeigte speziell die Entwicklung von Nvidia’s Near-Eye Lichtfeld-Display Prototypen:

In der zweiten Hälfte der Präsentation bespricht Lanman die beiden Nvidia-Prototypen:

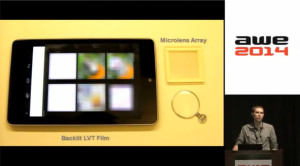

Der erste, LVT-Film (Light Valve Technology) basierte Prototyp nutzt ein Android tablet in Verbindung mit einem Laser-bearbeiteten Film und simuliert dadurch ein 4×4 cm 8K Display (Ultra-High Definition). Echte, massenproduzierte 8K-Displays werden für die nächsten 3-5 Jahre erwartet.

Der zweite Prototyp ist die Binokular-OLED basierte Brille, die im Vorjahr auf der SIGGRAPH 2013 vorgestellt wurde. Sie wurde aus einem wieder instand gesetzten Sony HMZ-T1 3D-Headset mit zwei 1-Zoll 720p OLED-Panelen umgebaut. Das Gerät wurd ezerlegt, mit Mikrolinsenrastern ausgestattet, und in ein speziell 3D-gedrucktes Gehäuse verbaut. Während das optische Setup im Sony-Original an die 65 g wiegt und 4 interne Linsen enthält, wiegt die modifizierte Version mit einem Mikrolinsenraster nur 0.7 g und ist deutlich günstiger herzustellen.

Im Vergleich zu bestehenden Displays können Near-Eye Lichtfeld-Displays extrem dünn und leicht gefertigt werden. Sie bieten zudem einen viel breiteren Betrachtungswinkel, was zu einem deutlich realistischeren Benutzererlebnis führt. Ein weiterer wichtiger Vorteil ist der Komfort: Die Brille kann optische Schwächen im Auge (z.B. Weit- oder Kurzsichtigkeit) rein durch Softwareeinstellungen ausgleichen, und verhindert den sogenannten Accommodation-Convergence Konflikt, der zu Übelkeit führen kann wenn die Augen durch den Tiefeneindruck versuchen, auf etwas weiter entferntes (hinter das eigentliche Display) zu fokussieren und dadurch nur ein verschwommenes Bild sehen.

Natürlich gibt es (vorerst) auch noch Einschränkungen der Technologie: Die Verwendung von Mikrolinsenrastern verringert räumliche Auflösung um einen Faktor von 5 bis 6 (im aktuellen Prototyp; bei Lytro-Kameras um den Faktor 10), aber dieses Problem sollte durch die immer weiter steigende Auflösung von OLED-Panelen in naher Zukunft gelöst werden. Die VR-Brille benötigt auch größere Mikrolinsenraster, und setzt eine Kalibrierung auf die Augen der jeweiligen Benutzer voraus, um eni optimales Ergebnis zu erzielen.

Heute gängige Technologie (im zweiten Prototypen verwendet) ermöglicht eine räumliche Auflösung von 150-200 Pixeln (horizontal) und einen Betrachtungswinkel von ca. 40 Grad. Lanman zufolge können hochauflösende Brillen mit bis zu 80 Grad Betrachtungswinkel aber schon in drei bis fünf Jahren Wirklichkeit werden.

Legt man die Hardware kurz beiseite, kommt immer noch das Rendering der Bilder für Lichtfeld-Displays als potentiell aufwändige Aufgabe hinzu. Wie Lanman und seine Kollegen allerdings zeigen konnten, kann “fast jede Game Engine” mit nur 50 Zeilen Code für stereoskopisches Lichtfeld-Rendering auf einem Standard-PC erweitert werden.

Auf die Frage, ob auch Augmented Reality mit solchen Brillen möglich wäre, deutete Lanman eine neue “Pinlight Display AR” Technik an, die anscheinend bei der AWE2014 Konferenz gezeigt wurde und in Kürze publiziert werden sollte.

Neueste Kommentare